1. GA的基本原理

GA的基本原理是利用生成器和判别器之间的对抗来学习真实数据的潜在分布。生成器的目标是欺骗判别器,使其无法区分生成样本和真实样本。而判别器的目标是尽可能区分生成样本和真实样本。在训练过程中,生成器和判别器会不断调整自己的参数,使得生成器能够生成更加逼真的样本,而判别器能够更加准确地识别出生成样本。

2. 生成器网络

生成器网络通常是一个神经网络,其输入是随机噪声,输出是生成的样本。在训练过程中,生成器会根据判别器的反馈来调整自己的参数,使得生成的样本更加逼真。

3. 判别器网络

判别器网络也是一个神经网络,其输入是真实样本或生成样本,输出是判断该样本是否真实的概率。在训练过程中,判别器会根据生成器的输出和真实样本的分布来调整自己的参数,使得自己能够更加准确地识别出生成样本。

4. 损失函数

GA的损失函数通常由两部分组成:生成器的损失函数和判别器的损失函数。生成器的损失函数通常是一个交叉熵损失函数,用于优化生成器的参数,使得生成的样本更加逼真。判别器的损失函数通常是一个二元交叉熵损失函数,用于优化判别器的参数,使得判别器能够更加准确地识别出生成样本。

5. 训练过程

GA的训练过程通常采用交替优化的方法:首先固定生成器参数,训练判别器;然后固定判别器参数,训练生成器。在每个训练步骤中,生成器和判别器都会根据对方的表现来调整自己的参数,直到达到一定的收敛条件。

6. 生成对抗生成网络的应用

GA在许多领域都有广泛的应用,例如图像生成、图像分类、语音识别等。在图像生成方面,GA可以生成各种类型的图像,例如人脸、动物、风景等。在图像分类方面,GA可以通过生成具有不同特征的图像来提高分类器的性能。在语音识别方面,GA可以用于语音合成和语音识别等任务。

7. GA的优化和改进

为了提高GA的性能和稳定性,许多研究者提出了各种优化和改进的方法。例如,采用不同的优化算法、调整损失函数的权重、引入正则化项等。这些方法都可以在一定程度上提高GA的性能和稳定性。

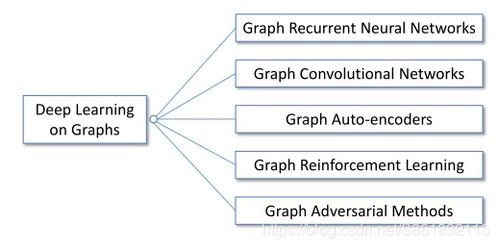

8. GA与其他技术的结合

GA可以与其他技术结合使用,例如与卷积神经网络、循环神经网络等结合使用,以进一步提高模型的性能和鲁棒性。GA还可以与强化学习等技术结合使用,以实现更加复杂的任务和目标。